„Ein Bild, ist kein Bild“ lautet einer der Sprüche in der Astrofotografie, denn die erzielbare Bildqualität wird erheblich gemindert durch verstärktes Rauschen und der Luftunruhe. Ersteres durch dem wenigen Licht das uns zur Verfügung steht, sodass wir über längere Zeit belichten müssen und dabei natürlich auch eine höhere ISO verwenden. Die Luftunruhe merkt man, je stärker man vergrößert. Sie schwankt sehr, und es kann durchaus sein, dass ein Bild kurzer Belichtungszeit fast perfekt ist, das nächste aber sehr verschwommen.

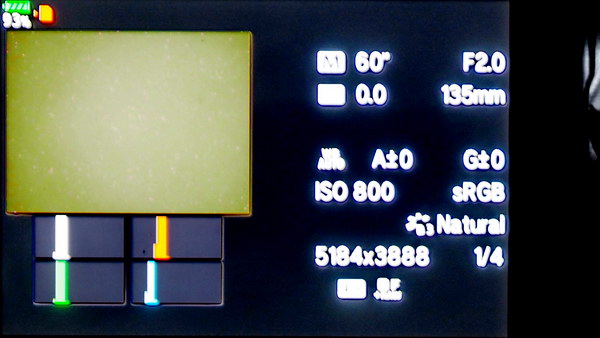

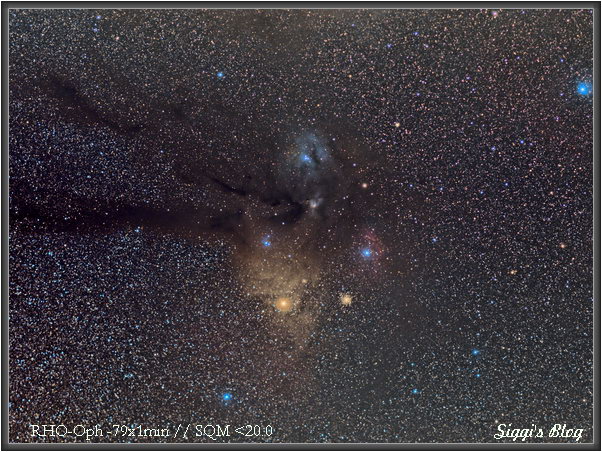

Bei der Fotografie des Nachhimmels steht eher das Bildrauschen eine Rolle, es sind ja großflächigere Bereiche und Objekte mit Brennweiten von den üblichen Fotooptiken bis so 1000mm, aber die Belichtungszeiten liegen eben in etwa zwischen 1 und 8 Minuten bei ISO800, je nach verfügbarer Lichtstärke.

Mond, Sonne und Planeten sind dagegen hell bis sehr hell, daher bleiben die Belichtungszeiten oft deutlich unter einer Sekunde, oft unter 1/100-1/4000s. Daher spielt hier das Sensorrauschen weniger eine Rolle, dafür aber die Luftunruhe. Die Planeten sind dazu sehr klein und bedürfen dann einer extrem starken Vergrößerung.

Ein Methode um 1 gutes Bild zu erhalten ist es: Viele Bilder zu machen und dann das Bild heraussuchen, wo die Luft am ruhigsten war. Das nennt sich „Lucky Image„. Wer auf höchste Auflösung steht, wird aber auch da Bildrauschen vorfinden, weil man ja dann oft eine 100% Ansicht herausschneidet um eine vernünftige Größe zu bekommen. Und die Waffe gegen Rauschen ist es halt, möglichst viele Bilder zu mitteln. Wer nämlich ein verrauschtes Bild versucht zu schärfen wird die Artefakte mitverstärken, wer entrauscht, wird feine Details mit entsorgen. Daher wird man möglichst viele Bilder stacken wollen und zwar nur möglichst viele der spärlichen „Lucky Images“.

Anders als bei „Deep Sky“ Bildern, wo es ja jede Menge Sterne gibt, die der Stacking Software als Anhaltspunkt zum Zusammenrechnen dienen, hat man es bei Mond/Sonne und Planeten mit großflächigen Strukturen zu tun. Man braucht also spezielle Software, die solches erkennt.

Auch hat man es bei den „Deep Skybildern“ mit einer vergleichsweisen überschaubaren Anzahl von Einzelbildern zu tun, so um die 30-300 Bilder um eine Zahl zu nennen, bei Planeten bewegt man sich da dann schon eher zwischen 1000 und 10.000 Bilder pro Serie! Das muss man erstmals speichern, beurteilen und dann bearbeiten wollen/können.

Daher ist die Planetenfotografie immer schon ein Domaine der „Webcams“: Man benötigt nur einen kleinen Sensor und produziert ein möglichst unkomprimiertes Video. Je höher die Framerate (USB2 vs. USB3), aus desto mehr Einzelbilder besteht das Video. Da man fast nur das winzige Objekt am Film hat, bleibt die Dateimenge noch im Rahmen. Bei Mond wird bei diesen Vergrößerungen nur mehr ein kleiner Teil abgebildet, das aber perfekt! Ein Mosaik aus 10-50 Bildern ergibt dann ein höchst aufgelöstes Mond Bild. Dagegen kann kein Stack aus der Fotokamera mithalten…..aber wir wollen hier betrachten, was wir mit unseren Fotokameras anstellen können:

Mond und Sonne sind bei unseren FT Sensoren bei ca 1,1m Brennweite formatfüllend. Wer einen 1,4x Telekonverter sein eigen nennt, kommt also bequem mit 800mm Brennweite dahin. Mit „Silent Shutter“ kann man bis zu 60 Bilder / Sekunde hochauflösend erhalten. Also man kann relativ leicht seine vielen hundert Einzelbilder erhalten. Natürlich verwenden wir RAW. Bei einem HD-Video reichen aber 800mm Brennweite, weil selbst ein HD-Video nur ein Bruchteil der maximal möglichen Auflösung eines 16 oder 20 MPixel Sensors besitzt. Bei Jupiter kommt ein Problem dazu: Er dreht sich sehr schnell (nur etwas über 9 Stunden) sodass man ab 1 Minute bereits Verwischung sehen könnte.

Wer die HQ-Auflösung (50-70 MPixel derzeit) für seine Bilder vom Mond/Sonne benützt, erhält zwar wirklich eindrucksvolle Bilder, aber da 8 Bilder in der Kamera versetzt zusammengerechnet werden müssen wird das wohl nur bei absolut perfekten Seeing einen Sinn machen. Und diesen sehr sehr seltenen Moment muss man erst mal erwischen. Zwischendurch probieren kann man es ja mal….

Seit langem gibt es spezialisierte Software für die Planetenfotografie: Giotto oder Registax zum Beispiel. Aber sie werden seit geraumer Zeit nicht mehr weiterentwickelt und sind nur für kleine Dateigrößen ausgelegt. Einzig mit FITSworks konnte ich bis 20 MPixel Bilder des Mondes erfolgreich stacken. Bei HR Dateien, skalierte FITSWork stark herunter. Eine Stack von ausgewählten 100 Bildern dauert so einen halben bis ganzen Tag….

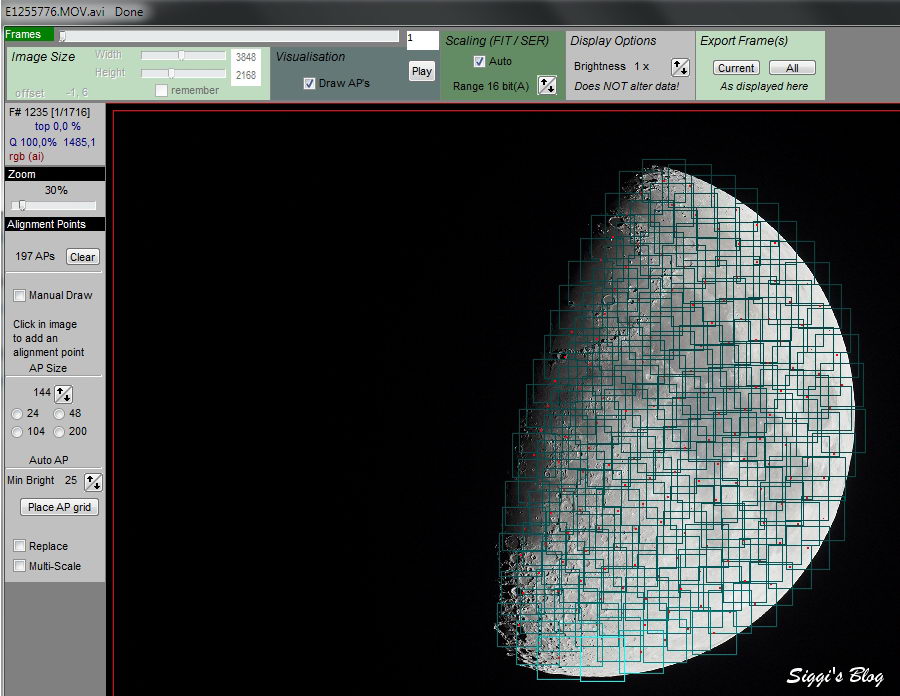

Schon ein „Lucky Image“ aus der Fülle der Bilder herauszufischen ist sehr anstrengend. Zum Glück gibt es da aber jetzt Hilfe: AutoStakkert (AS!). Wer sich dann noch mit Planetenfotografie herum schlägt, wird schnell den Wunsch verspüren, das viele schwarze Rundherum wegzuschneiden. Das erledigt souverän PIPP (Planetary Imaging PreProcessor). Als Startdatei kann man sowohl Video (AVI/MOV etc) wie auch TIFF oder ORF Files verwendet. Das Ergebnis dann als TIFF/FITS oder unkomprimiertes AVI Speichern lassen. Das versteht dann AS!.

Wer sich ffmpeg herunterlädt und das ffmpeg.exe in das Verzeichnis von AS! legt, der kann direkt auch die MOV Datei seiner Kamera als Ausgangsbasis verwenden. Wer allerdings ORF Files in AS! stacken will, muss sie vorher in TIFF Files umwandeln . Also entweder mit OlyViewer, oder PIPP oder was auch immer das ORF File als TIFF exportieren.

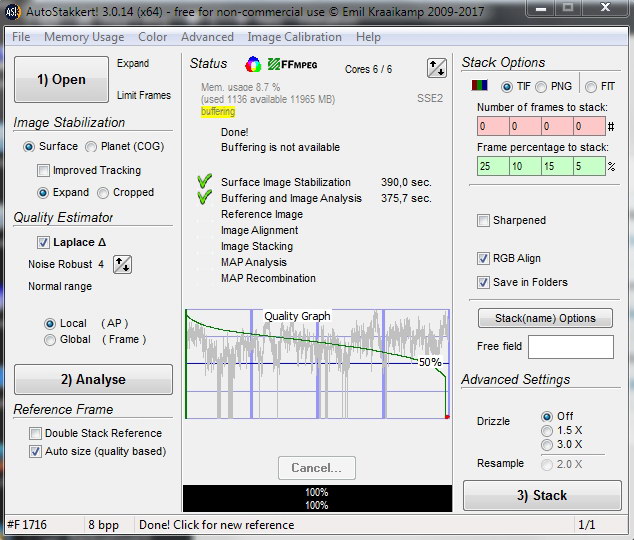

Stacken mit Autostakkert:

1.) Zuerst seine Dateien (TIFF) öffnen oder als AVI Video (MOV wenn ffmpeg vorhanden).

2.) Analyse: Es erfolgt eine Analyse der Einzelbilder

Man sieht dann eine Status der Verteilung der Bildqualität der Bilder in der Kombigrafik: Die Schwankung der Bildqualität der Reihenfolge der Einzelbilder, die Grüne Linie zeigt in etwa den Verlauf der Qualität der gesamten Bildserie.

In der Vorschau wählt man die Bereiche, die dann beim Stacken analysiert werden und herangezogen werden. Der Clou dabei: Es werden von den gewählten Ausschnitten nur die Bildinformationen gestackt, die am besten sind, was bei großflächigen Objekten wie Mond / Sonne ja durchaus abweicht, denn mal ist ein einem Bereich ein Teil scharf, der andere aber nicht. Es wird also nicht stur einfach Bild x + y + z gestackt sondern wirklich nur der Bereich aus den Bildern der jeweils am besten ist. Daher sollten diese Bereiche auch überlappen. Aber dazu gibt es auch Anleitungen auf der AS! Seite (wenn auch nur auf Englisch). Da ist viel Platz zum Optimieren seiner Bildserie.

Stack Option:

Man wählt sein Ausgabeformat des Stacks. Dann kann man sich aussuchen. AS! kann verschieden viele „der am besten befundenen“ Bildern stacken und legt dann ein Verzeichnis an wo die fertigen Stacks hineinkommen, mit entsprechender Bezeichnung im Filenamen. (liegt ein Verzeichnis unterhalb des Stammverzeichnis der Input Datei(en). Man kann also gleich mal je 4 verschiedene Stack’s anfertigen lassen: Entweder eine fixe Anzahl der gestackten Bilder oder Prozent Zahl. Wie viele der Bilder gestackt werden sollen, hängt sehr von der Qualität der Rohbilder ab. Sind sehr viele Bilder schlecht, wird man eher mit wenigen Bildern zum stacken sein Auslangen finden müssen.

Das ganze geht überraschend schnell !!

Da ich die gestackten Bilder hinterher erst bearbeite und brauch ich keine der angebotenen Bildverbesserungen die PIPP oder AS! bieten.

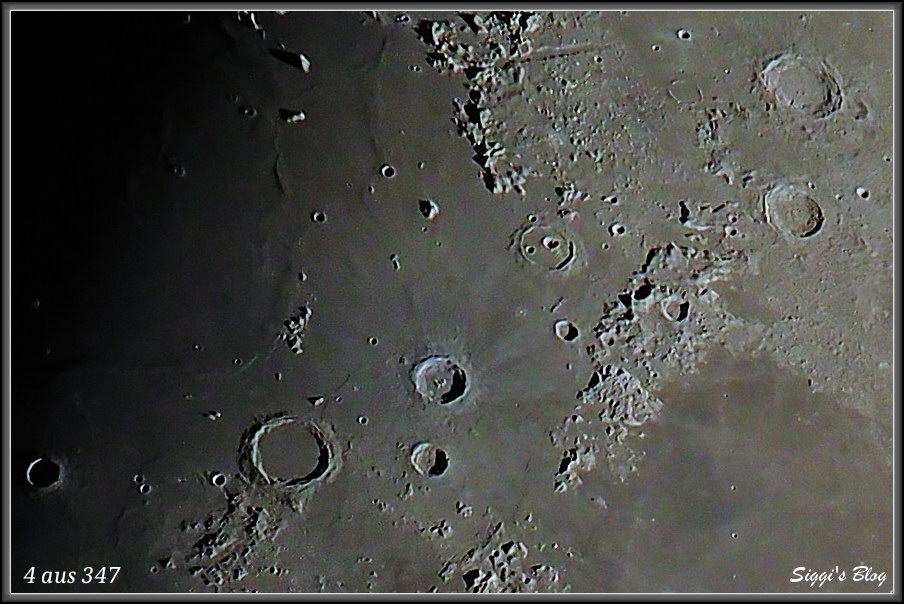

Hier ein 1:1 Ausschnitt eines Stacks der 4 besten Bilder aus 347:

Die kleineren klar sichtbaren Krater messen um die 4-5 km Durchmesser.

Hier noch ein erster Versuch am Jupiter:

50 aus 200 Bildern 1:1

Mittlerweile habe ich auch probiert HR Files aus der E-M1.II (70 MPixel !) zu stacken. Ich hatte dazu 28 Bilder zur Verügung die ich als TIFF exportierte. Das als Beste durch AS! gezeigte Bild habe ich dann quasi als OOC (out of cam) bearbeitet. Weiters lies ich dann AS! jeweils folgende Stacks erstellen: 4,5,6,7 beste Frames und 12, 15, 25 und 30%. Mit einem Computer mit einer Ryzen7 1700 CPU und 32GB RAM klappte das innerhalb 10-15 Minuten. Während der Bearbeitung wurden 27 GB RAM genutzt und alle 16 Threads der 8 Kern CPU wurden benutzt.